|

EN BREF

|

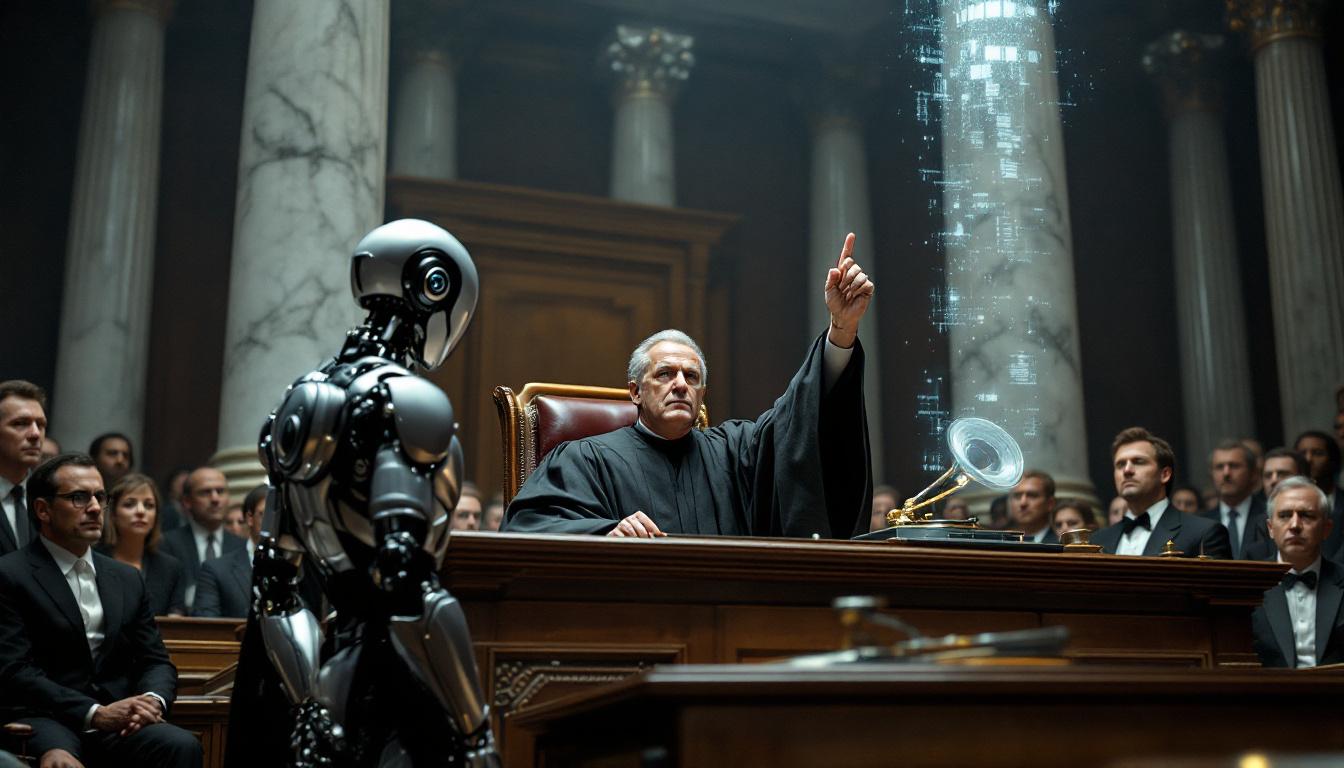

Le réseau social X, propriété d’Elon Musk, a récemment annoncé une nouvelle réglementation concernant les contenus vidéo liés aux conflits armés. À partir de maintenant, tous les créateurs de contenu doivent signaler clairement les vidéos de guerre générées par intelligence artificielle (IA). En cas de non-respect de cette directive, des sanctions allant jusqu’à la suspension du programme de partage de revenus seront appliquées. Cette mesure est mise en place pour contrer la propagation de la désinformation, particulièrement dans le contexte délicat du conflit actuel au Moyen-Orient.

Sommaire

ToggleUn durcissement des règles de monétisation

Avec la montée des fausses informations sur les réseaux sociaux, X a pris la décision de renforcer ses règles de monétisation. Les créateurs qui publient des vidéos fabriquées avec des outils d’IA doivent les signaler explicitement. En effet, des séquences trompeuses circulent dont certaines prétendent représenter des scènes réelles du conflit en cours. Cette initiative vise à garantir que l’information diffusée sur la plateforme soit authentique, surtout en période de crise.

Les sanctions en cas de non-conformité

Les créateurs qui omettront de mentionner l’utilisation de l’IA pour produire du contenu sur des conflits armés s’exposent à des sanctions sévères. Ainsi, le non-respect de cette obligation entraînera une suspension temporaire de 90 jours du programme de partage de revenus pour la première infraction. En cas de récidive, la sanction deviendra permanente. Cela met en lumière la volonté de X de protéger l’authenticité des contenus et d’éviter toute manipulation.

La nécessité d’une information authentique

Nikita Bier, responsable produit chez X, a souligné l’importance d’un accès à une information authentique sur le terrain en temps de guerre. En adaptant ses règles, la plateforme vise à renforcer la confiance des utilisateurs et à garantir que les contenus partagés soient fiables, surtout lorsque des événements tragiques se déroulent. Le besoin de véracité est plus crucial que jamais dans le cadre de la désinformation qui peut émerger pendant des conflits.

Signalement par les utilisateurs

Pour accompagner cette nouvelle régulation, X encourage également les utilisateurs à signaler les contenus qui pourraient susciter des doutes quant à leur authenticité. Cette collaboration entre la plateforme et sa communauté vise à assurer une vigilance accrue et à empêcher la prolifération de fausses vidéos, révélant ainsi l’engagement de X dans la lutte contre la désarmer information.

Désinformation et impact des images générées par IA

La présence de vidéos générées par IA dans le contexte des conflits armés n’est pas nouvelle. De nombreuses plateformes ont fait face à ce phénomène, et les conséquences sur la perception publique sont alarmantes. Des liens sont à établir entre la désinformation et l’utilisation croissante de la technologie IA dans la création de contenus. Pour une analyse approfondie de cette problématique, vous pouvez lire des articles pertinents tels que l’impact des images générées par l’IA ou les deepfakes et leur utilisation stratégique.

Il est primordial que les utilisateurs de X soient conscients des implications de leurs publications, surtout quand il s’agit de conflits armés. La règlementation introduite par le réseau social X représente un pas vers une information plus vérifiable et un contrôle plus rigoureux des contenus diffusés. En maintenant une transparence sur l’utilisation de l’IA, X espère restaurer la confiance des utilisateurs et réduire la désinformation. Pour une étude sur l’automatisation du travail intellectuel par le gouvernement, consultez ce lien.