|

EN BREF

|

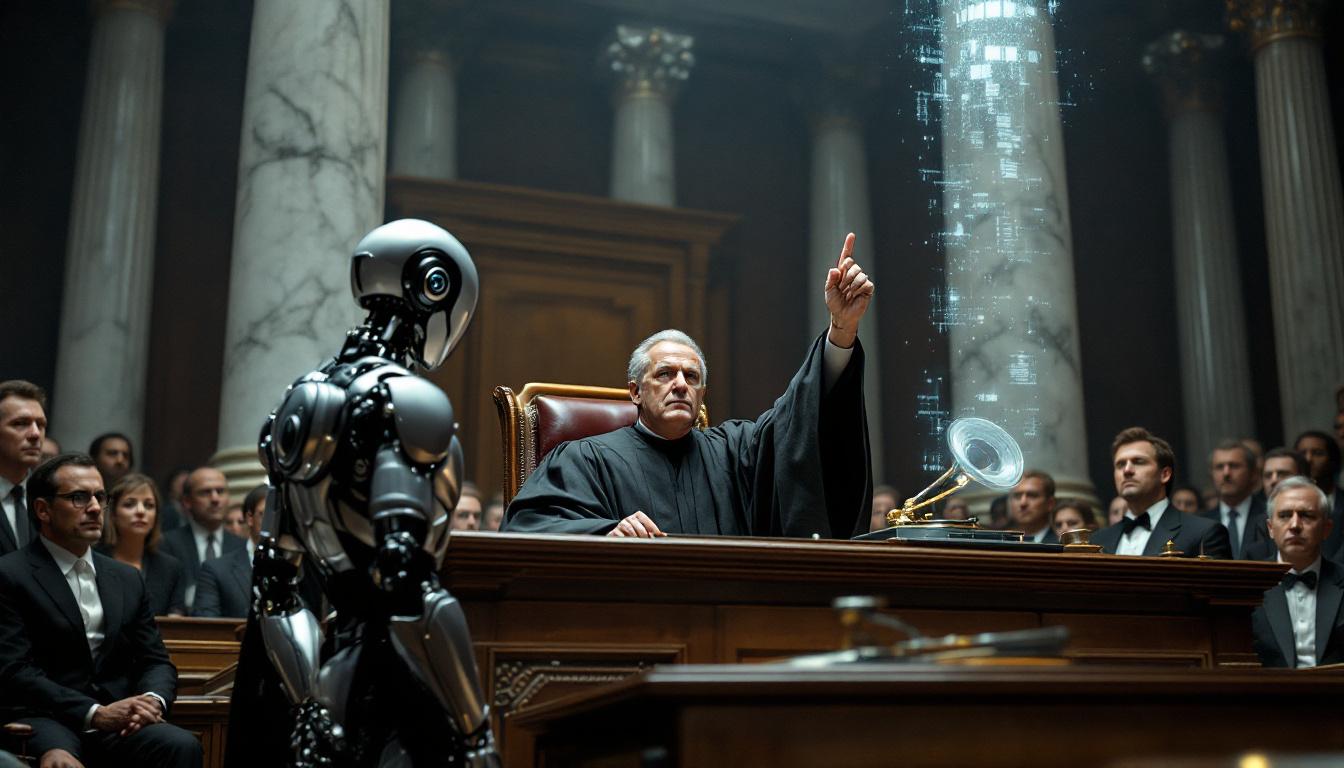

À mesure que l’intelligence artificielle (IA) s’immisce dans notre quotidien et devient un copilote dans nos processus décisionnels, il devient crucial de comprendre les dangers liés à une confiance inconditionnelle envers ces outils. Bien que l’IA puisse améliorer nos performances, elle peut aussi biaiser notre perception de nos propres compétences, entraînant une surestime de nos capacités et une perte de sens critique. Cet article explore les risques associés à cette dynamique et les conséquences potentielles de cette confiance aveugle.

Sommaire

ToggleUne illusion de compétence

L’usage d’outils d’intelligence artificielle comme ChatGPT peut mener à des résultats impressionnants. De nombreuses études, dont celles rapportées par PsyPost, montrent que les utilisateurs obtenant l’assistance de l’IA réussissent souvent mieux des exercices difficiles. Cependant, ce succès apparent est compensé par un effet inverse : les utilisateurs peinent à évaluer correctement leurs performances, surestimant leurs résultats de manière significative. Ce décalage entre réalité et perception peut devenir problématique dans des domaines où l’autocritique est essentielle.

Des conséquences sur l’auto-évaluation

La confiance excessive en l’IA impacte la capacité des individus à se juger avec précision. Contrairement à ce que l’on pourrait penser, disposer d’une solide culture technique de l’IA ne garantit pas une meilleure auto-évaluation. Une étude parue dans Computers in Human Behavior montre que même les utilisateurs les plus compétents en technique surestiment systématiquement leurs performances, créant ainsi un biais généralisé. Cela souligne une perte de sens critique qui peut affecter gravement des décisions, notamment dans des environnements professionnels et éducatifs.

La dégradation de la prise de décision

Le risque majeur associé à une confiance aveugle en l’IA est la dégradation de la qualité des décisions. Lorsque les utilisateurs reposent trop sur les recommandations de l’IA sans vérification, ils manquent de remettre en question les informations fournies. Les recherches montrent que cette acceptation passif des réponses d’IA a des conséquences néfastes. En effet, lorsqu’une réponse erronée est acceptée, cela peut réduire l’efficacité globale des performances combinées humain-machine, qui devient alors inférieure à celle de l’IA seule. Cette tendance peut constituer une menace significative dans des domaines aussi critiques que la santé ou la finance.

Un manque de réflexion critique

Les utilisateurs qui s’appuient sur l’IA sont souvent moins enclins à remettre en question les logiques proposées par ces outils. L’étude analysant les journaux de discussion des participants révèle que la plupart se contentent de reproduire les questions et d’accepter les réponses automatiquement fournies. Ce manque de remise en question ne fait qu’accentuer l’illusion de compétence, tandis que les compétences réelles des utilisateurs ne sont pas développées. La conception des outils d’IA doit intégrer des mécanismes favorisant la réflexion critique afin d’éviter de telles dérives.

Les enjeux d’une confiance trop aveugle

Les implications d’une confiance aveugle en l’IA sont profondément préoccupantes. Cette dynamique non seulement favorise un biais de jugement, mais entraîne aussi une acceptation passive d’erreurs potentiellement drastiques. Dans un monde où l’IA a un impact croissant, comme le montre l’actualité autour de la perturbation d’astéroïdes et d’autres enjeux technologiques, il est impératif d’encourager une <utilisation critique des outils d’IA pour éviter des erreurs fatales dans les décisions que nous prenons au quotidien.

Les utilisateurs doivent être conscients de ces dangers et développer une attitude réflexive vis-à-vis des décisions automatisées pour maintenir un équilibre entre l’utilisation de l’IA et la préservation de leur acuité mentale. La vigilance et la formation sont plus que jamais nécessaires pour naviguer dans ce paysage technologique complexe.