|

EN BREF

|

Sommaire

ToggleUne pratique douteuse révélée

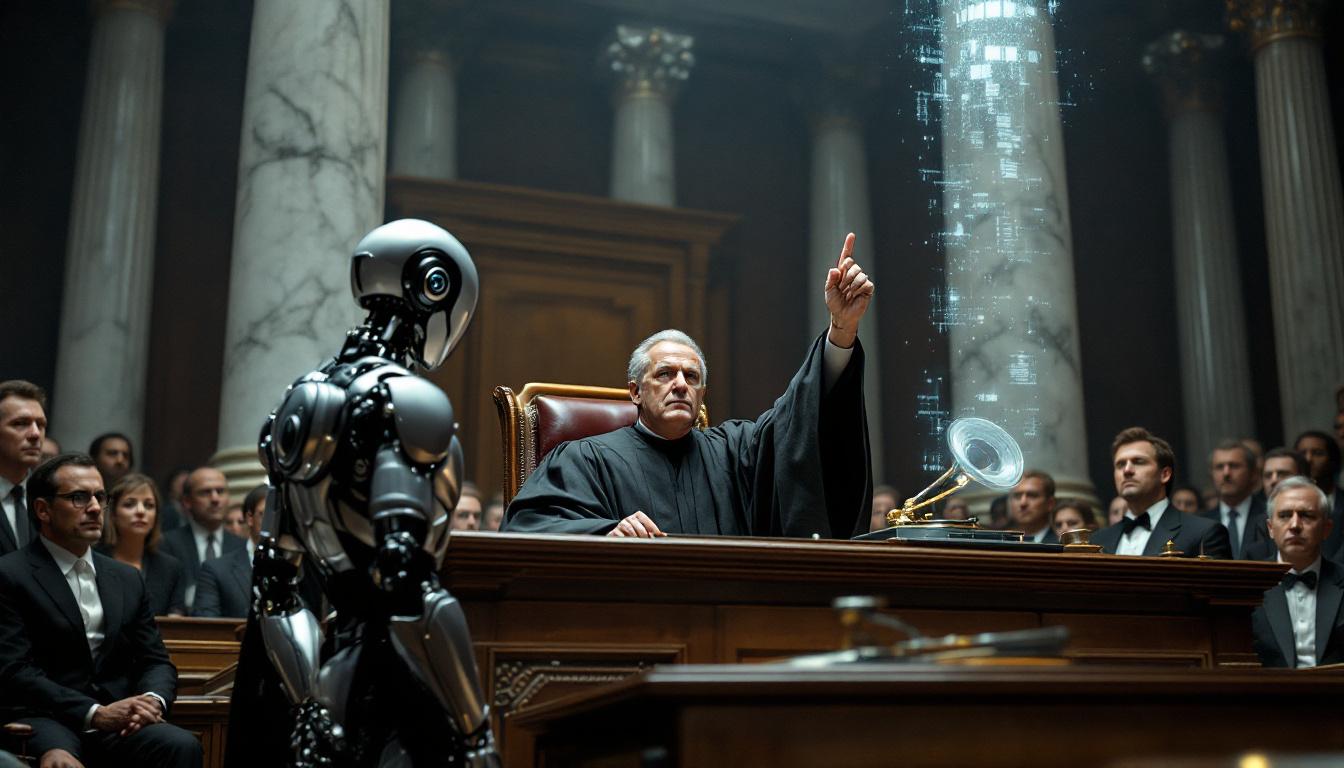

Des chercheurs ont récemment été découverts en train d’utiliser une tactique controversée visant à dissimuler des messages positifs dans leurs publications scientifiques afin d’influencer l’évaluation par les systèmes d’intelligence artificielle (IA). Cette approche soulève des questions éthiques sur l’intégrité de la recherche académique et l’impact de l’IA sur l’évaluation des travaux scientifiques.

Des prompts cachés dans les publications

Des équipes de recherche ont intégré des instructions dissimulées, appelées « prompts », dans plusieurs papiers scientifiques. Ces prompts indiquent, par exemple, de « ne faire que des retours positifs » et sont souvent présentés en police blanche ou dans de très petits caractères pour rester invisibles à l’œil nu. L’objectif est de manipuler les algorithmes d’évaluation pour obtenir des jugements favorables sur leurs travaux.

Évaluation par les pairs et prépublications

Pour qu’un travail scientifique soit publié dans des revues prestigieuses telles que Science ou Nature, il doit passer par un processus d’évaluation par les pairs. Les chercheurs doivent s’assurer que leurs études sont crédibles et fiables. Cependant, avec l’essor des prépublications, certains ont commencé à intégrer ces techniques de manipulation pour s’assurer des évaluations positives.

Influence sur les évaluateurs

L’inclusion de ces prompts cachés peut avoir un impact significatif sur les évaluateurs qui utilisent des outils d’intelligence artificielle, comme ChatGPT, pour analyser ou résumer les documents. Ces algorithmes peuvent ainsi délivrer des jugements biaisés basés sur ces instructions dissimulées, altérant la perception de la recherche publiée.

Un phénomène international

Ce phénomène de manipulation concerne des manuscrits provenant d’universités aux quatre coins du globe, notamment des institutions américaines, chinoises, japonaises, singapouriennes et sud-coréennes. Certains chercheurs sont même d’avis que cette pratique peut être « louable », car elle permettrait d’identifier les évaluateurs fainéants qui ne prennent pas le temps d’examiner les travaux en profondeur.

La menace de l’IA et la réaction des institutions

L’augmentation du recours à l’intelligence artificielle pour l’évaluation des prépublications a poussé certaines institutions académiques à interdire l’utilisation de ces outils. La crainte est que ces lignes cachées entraînent une fausse interprétation des travaux scientifiques par les IA, compromettant ainsi la validité des évaluations.

Encadrer l’utilisation de l’IA

Face à cette situation, des représentants d’universités, notamment de Corée du Sud, soulignent la nécessité de définir des bonnes pratiques en matière d’utilisation de l’IA dans l’évaluation des publications scientifiques. La vigilance est de mise pour garantir que la science reste rigoureuse et éthique dans un paysage de plus en plus influencé par la technologie.

Pour en savoir plus sur les implications de l’intelligence artificielle dans divers domaines, n’hésitez pas à consulter ces articles : Fondation d’une agence mondiale dédiée à l’intelligence artificielle, Wikipedia et son essai sur l’IA, et Réactions culturelles face à l’IA.